Привет на связи Павел Гречко сегодня разберём как найти дубли страниц, отдающих код 200. Разберем, какие это могут быть дубли и как их исправить.

Возможные типы дублей страниц на сайте

- Дубли страниц с протоколами http и https.Например: https://site.ru и http://site.ru

- Дубли с www и без.Например: https://site.ru и https://www.site.ru

- Дубли со слешем на конце URL и без.Например: https://site.ru/example/ и https://site.ru/example

- Дубли с добавлением на конце URL:

- index.php

- home.php

- index.html

- home.html

- index.htm

- home.htm

Как обнаружить дубли страниц?

Поиск дубликатов страниц может быть выполнен различными методами. Если ваша цель – собрать все возможные дубликаты и не упустить ничего, наилучшим вариантом будет использование всех перечисленных сервисов вместе. Однако для обнаружения основных дубликатов достаточно выбрать любой удобный вам инструмент из списка и использовать его.

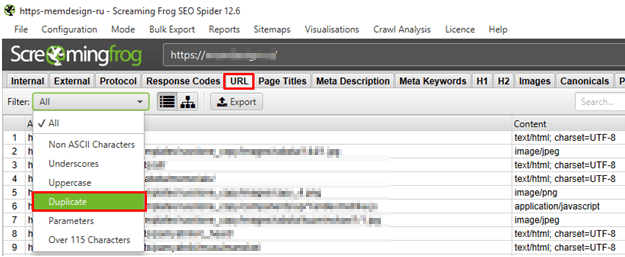

Парсинг сайта в Screaming Frog SEO Spider

Для поиска дубликатов подходит программа Screaming Frog SEO Spider. Запускаем сканирование, а после него проверяем дубли в директории URL → Duplicate:

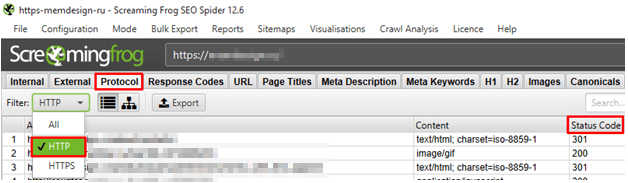

Кроме того, в директории Protocol → HTTP проверяем страницы с протоколом http — есть ли среди них те, у которых Status Code равен 200:

Панели веб-мастеров Яндекса и Google.

Найти дублирующиеся страницы можно с помощью собственных инструментов поисковиков — Яндекс.Вебмастера и Google Search Console.

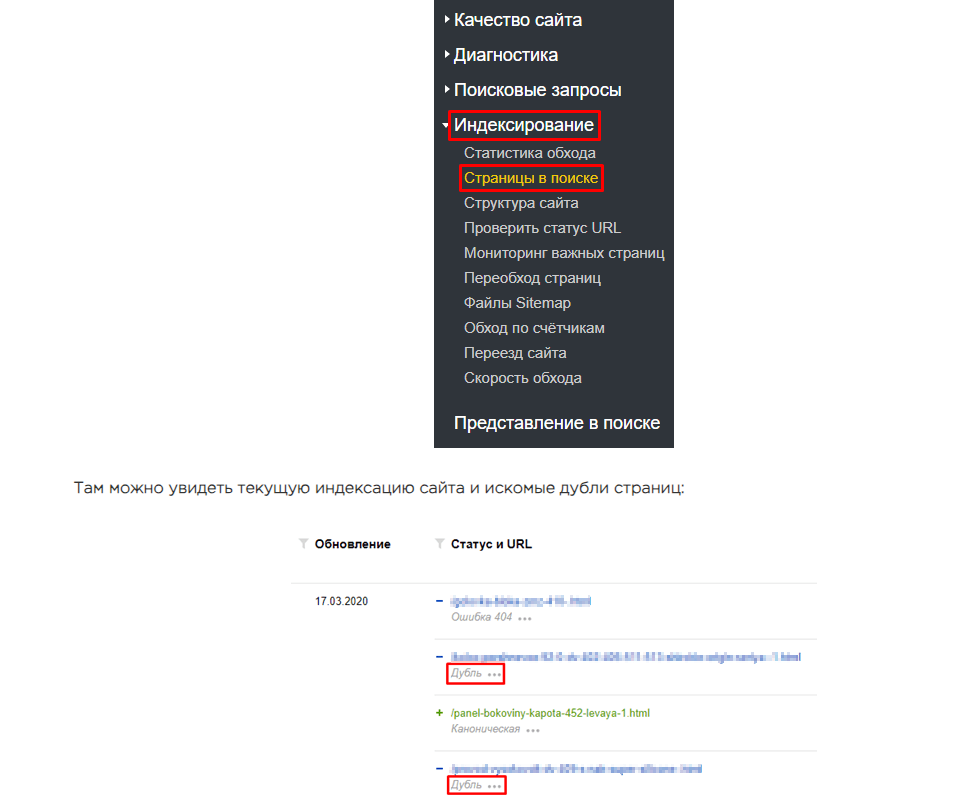

В Яндекс.Вебмастере анализируем раздел «Индексирование», далее — «Страницы в поиске»:

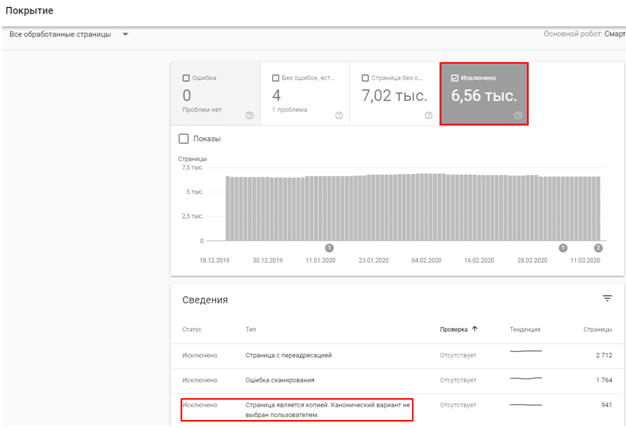

В Search Console анализируем раздел «Покрытие», а именно пункт с исключенными из индекса страницами:

Как убрать дубли страниц на сайте?

301 редирект

Ниже даны наиболее используемые правила настройки файла .htaccess для 301-редиректа. Лучше размещать все правила после двух строк:

Options +FollowSymLinks

RewriteEngine On

Комментарий в файле обозначается символом решётка «#» в начале строки #

# Текстовый комментарий, данная строчка не будет обрабатываться.

301-редирект с домена без WWW на домен с WWW префиксом #

RewriteCond %{HTTP_HOST} ^site\.ru$ [NC]

RewriteRule ^(.*)$ http://www.site.ru/$1 [R=301,L]

С домена с WWW префиксом на без #

RewriteCond %{HTTP_HOST} ^www.site\.ru$ [NC]

RewriteRule ^(.*)$ http://site.ru/$1 [R=301,L]

Для HTTPS-версии:

RewriteCond %{SERVER_PORT} ^80$ [OR]

RewriteCond %{HTTP} =on

RewriteRule ^(.*)$ https://pixelplus.ru/$1 [R=301,L]

Стандартная переадресация с одной статической страницы на другую #

Redirect 301 /was.php http://www.site.ru/new.php

При этом, новый адрес указывать необходимо полностью с http и доменным именем.

В ряде случаев полезна переадресация через RewriteRule #

RewriteRule ^dir /dir-new/$1 [R=301,L]

Настройка переадресации на папки со слешем в конце / #

RewriteCond %{REQUEST_FILENAME} !-f

RewriteCond %{REQUEST_URI} !\..{1,10}$

RewriteCond %{REQUEST_URI} !(.*)/$

RewriteRule ^(.*)$ http://www.site.ru/$1/ [L,R=301]

Настройка переадресации на папки без слеша (убираем слеш в конце) #

RewriteCond %{REQUEST_FILENAME} !-d

RewriteCond %{REQUEST_URI} ^(.+)/$

RewriteRule ^(.+)/$ http://www.site.ru/$1 [R=301,L]

Перенос сайта на версию с HTTPS (для всех страниц) #

RewriteCond %{SERVER_PORT} ^80$ [OR]

RewriteCond %{HTTP} =on

RewriteRule ^(.*)$ https://domain.ru/$1 [R=301,L]

Создание канонической страницы

Использование canonical указывает поисковому пауку на ту единственную страницу, которая является оригинальной и должна быть в поисковой выдаче.

Чтобы выделить такую страницу, нужно на всех URL дублей прописать код с адресом оригинальной страницы.

Директива Disallow в robots.txt

В файле robots.txt содержатся инструкции для поисковых краулеров, как именно индексировать сайт.

Если на сайте есть дубли, можно запретить роботу их индексировать с помощью директивы:

User-agent: *

Disallow: /blabla/

Итог

В общем надо всё найти и составить ТЗ как это всё поправить. Дать програмисту задание. Потом проверить обязательно его работу, а то есть вероятность что накосячит и сайт выпадет из поиска.